Die seit einem Jahrhundert bewährte Wahl für Effizienz, Werkzeugstandzeit und Oberflächenqualität

Warum der Werkzeugmittelpunkt-Höhenversatz der stille Killer beim Präzisionsdrehen ist

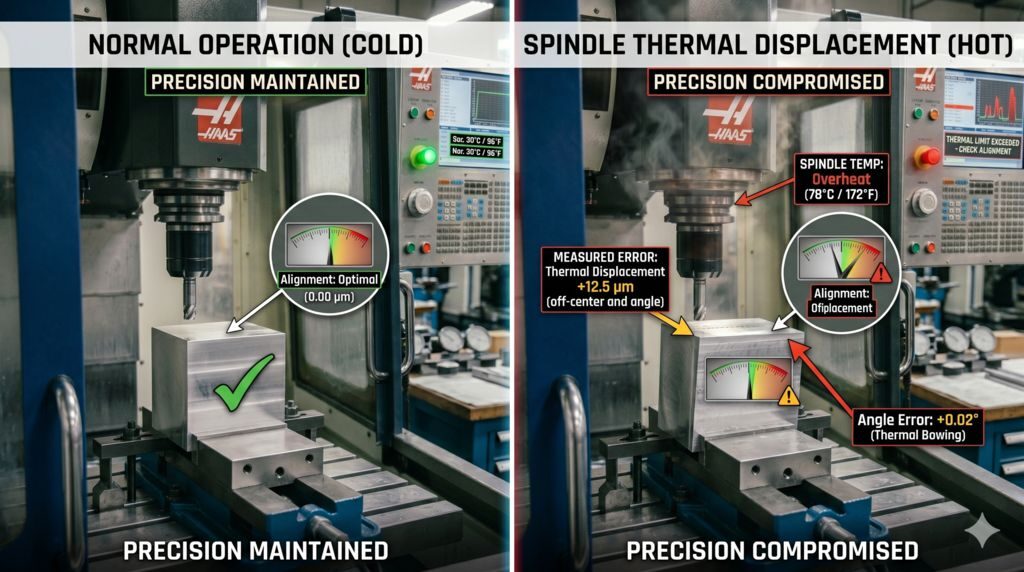

Analyse der zerstörerischen Kraft der thermischen Spindelverformung bei der Präzisionsbearbeitung

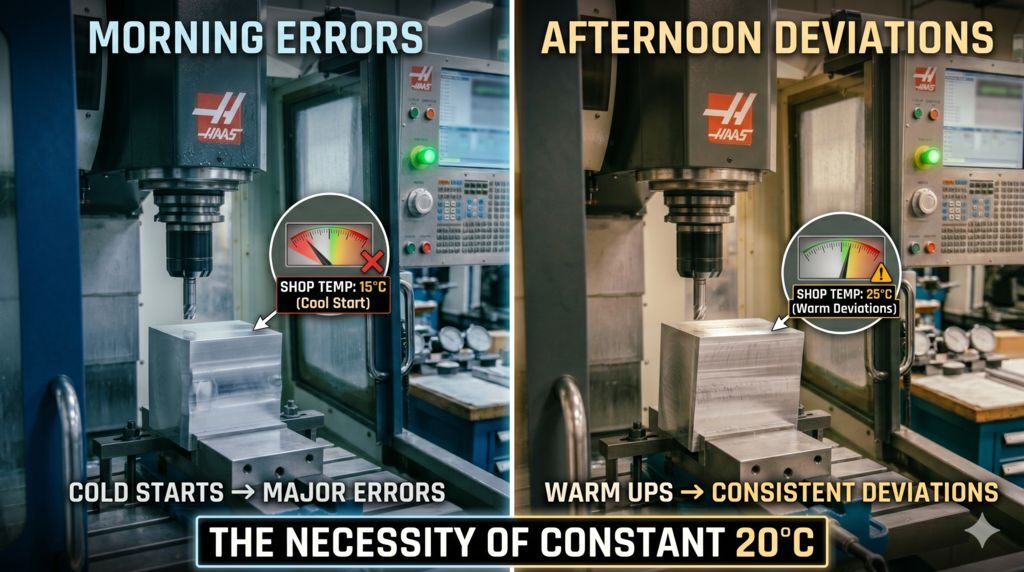

Warum Präzisionsanlagen eine konstante Temperatur von 20 °C aufrechterhalten müssen

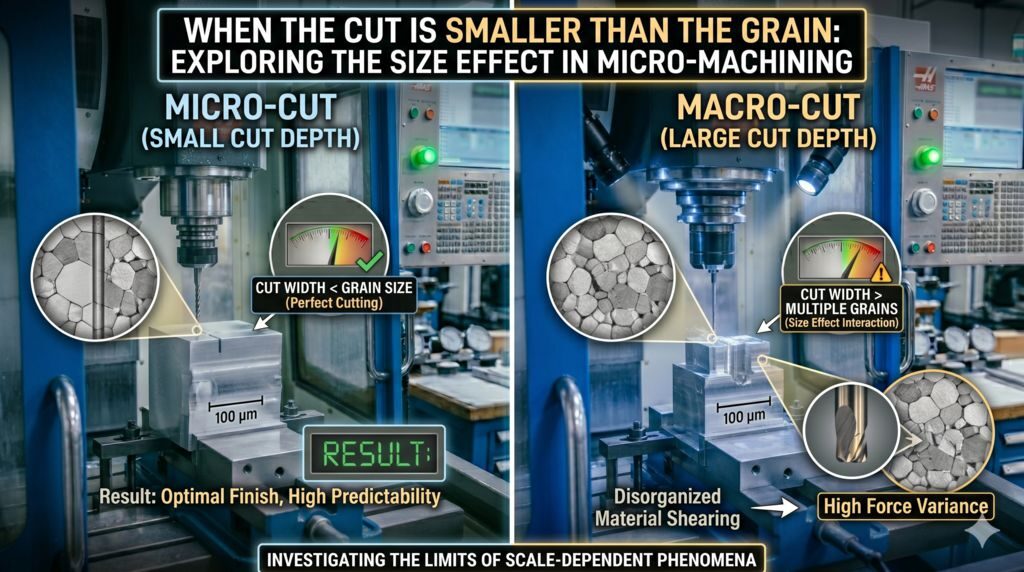

Wenn der Schnitt kleiner als die Faserrichtung ist: Untersuchung des Größeneffekts bei der Mikrobearbeitung

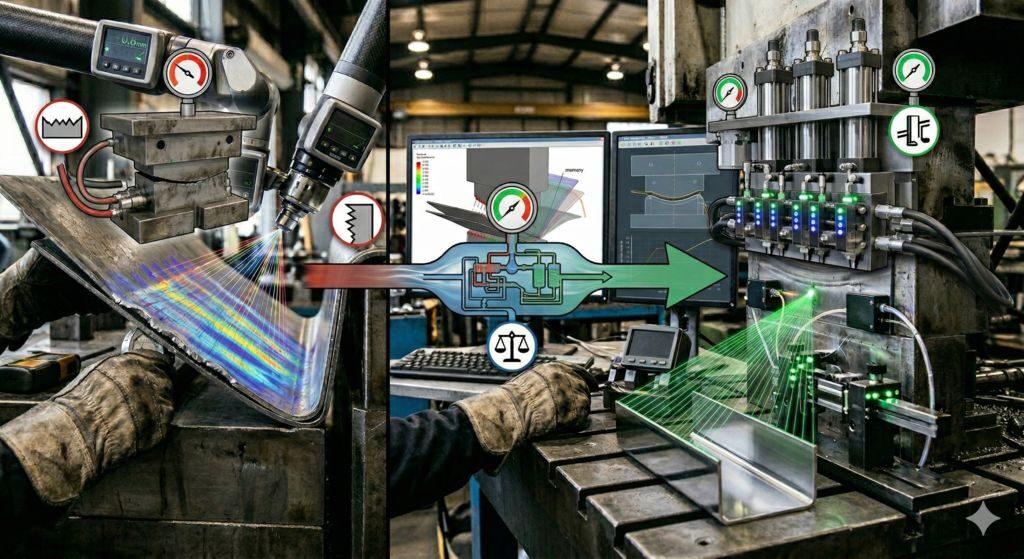

Von gerissen zu makellos: Die Magie des hydrostatischen Drucks beim Feinschneiden

Take a close look at a standard stamped metal part—perhaps a cheap washer or a basic bracket. If you look at the cut edge, you will notice a distinct, ugly pattern. The top half of the edge might look smooth and shiny, but the bottom half looks like a microscopic cliff face: violently torn, rough, and jagged, usually finishing with a sharp burr at the bottom.

For everyday items, that jagged edge is perfectly fine. But what if you are manufacturing a critical safety latch for a car door, or a high-precision gear for a medical device? A torn, rough edge creates weak points, causes premature wear, and simply isn't acceptable.

Historically, manufacturers had to stamp the part and then spend time and money shaving, milling, or grinding that torn edge smooth. That is, until the manufacturing world perfected a process called Fineblanking.

Fineblanking achieves what seems impossible: punching through solid steel and leaving a flawless, 100% smooth, mirror-like edge straight out of the press. The secret to this magic trick isn't just a sharper tool; it is the mastery of a fascinating physical phenomenon called Hydrostatic Pressure.

The Anatomy of a Tear: Why Metal Breaks

To understand how fineblanking fixes the problem, we first have to understand why metal tears in the first place.

During conventional stamping, a punch presses down on a sheet of metal resting on a die. As the punch pushes deeper, the metal begins to shear and slide against itself, creating that smooth, shiny area known as the burnish zone.

However, metal has its limits. Eventually, the pushing force exceeds the metal's ability to stretch and slide. Microscopic cracks form at the corners of the punch and the die.

These cracks rapidly connect, and the remaining metal suddenly snaps and gives way. This violent snapping creates the fracture zone—the ugly, torn section of the cut.

Metal tears because it wants to escape the pressure, and cracking is the path of least resistance.

The Core Concept: What is Hydrostatic Pressure?

If tearing is caused by the metal giving up and cracking, how do we force it to keep sliding? We trap it. We put the metal under so much pressure from every conceivable direction that a crack physically cannot form.

This state is known as Hydrostatic Pressure.

Imagine holding a handful of wet sand. If you poke it with your finger, the sand simply crumbles and breaks apart. But what if you take that same wet sand, put it inside a strong rubber balloon, and submerge it at the bottom of the Mariana Trench? The intense, crushing pressure of the ocean pushes inward on the balloon from every single direction equally.

If you could magically poke the sand now, it wouldn't crumble. The surrounding pressure is holding every grain so tightly together that cracks cannot propagate. Instead of crumbling, the sand would behave almost like a thick, viscous liquid. It would flow.

This is exactly what we do to solid steel during fineblanking. We create an artificial "deep ocean" pressure zone right at the cutting edge.

The Mechanics: Creating the Squeeze

To achieve this state of hydrostatic pressure, a fineblanking press acts very differently from a standard stamping press. It utilizes a three-part clamping system designed to trap the metal completely:

1. The V-Ring (The Stinger)

Before the punch even touches the metal, a heavy guide plate clamps down on top of the sheet. But this isn't a flat plate. It features a sharp, continuous, V-shaped ridge (the stinger) that bites deeply into the metal just millimeters outside of the cutting line. This V-ring creates a physical barrier. It locks the metal in place, stopping it from flowing outward away from the punch.

2. The Counterpunch

In standard stamping, the metal falls freely into a hole below the die. In fineblanking, there is no free fall. A counterpunch pushes up from the bottom, pressing firmly against the underside of the metal.

3. Near-Zero Clearance

Finally, the gap between the cutting punch and the receiving die is incredibly tight—often less than half a percent of the material's thickness.

The Result: Cold Extrusion

Let's look at the physics in action. The V-ring is biting down, preventing outward movement. The counterpunch is pushing up from the bottom. The main punch begins to push down from the top.

The metal trapped exactly on the cutting line is now in a state of immense hydrostatic pressure. Because it is squeezed so fiercely from the top, bottom, and sides, its physical properties temporarily change. Its plasticity skyrockets. The metal "forgets" that it is a solid and begins to behave like a highly viscous fluid.

As the punch moves through the material, the metal cannot crack. The microscopic voids that would normally form into tears are instantly squeezed shut by the surrounding pressure.

With cracking eliminated, the metal is forced to smoothly shear and extrude along the side of the punch for its entire thickness.

When the part is finally pushed out, the edge is 100% burnished. It is perfectly smooth, dimensionally flawless, and completely free of tear marks.

The Bottom Line

Fineblanking is a beautiful example of how engineering can outsmart the stubborn nature of raw materials.

By understanding the micro-mechanics of how metal cracks, and deploying the immense power of hydrostatic pressure to change the rules of physics, manufacturers can produce incredibly complex, ready-to-use parts in a single stroke of a machine. It is less about "cutting" metal, and entirely about forcing it to flow.

In addition, please visit CNC Turning Parts, Stamping Parts, Technical Data and Quality Inspection to get more information about us, if you have any question, please e-mail to Harry Yen hyen@unisontek.com.tw

Please watch our company YouTube channel Link and introduction Link